Zunächst war ich selbst beeindruckt. Ich schrieb, als würde ich einem Menschen schreiben und erhielt Antworten, wie ich sie von einer KI nicht kannte. Manchmal etwas umständlich, immer langatmig, niemals, sogar nach Aufforderung, mit „ja“ oder „nein“ antwortend. Allerdings kennt man untypische Arten von Textnachrichten auch von Menschen, weshalb es nicht sofort auffällt, dass die Texte von einer künstlichen Intelligenz stammen, sofern man nicht darüber nachdenkt.

Der große Sprung

OpenAI [2], die Firma hinter ChatGPT (Generative Pre-trained Transformer) [1], hat das KI-Rad nicht neu erfunden. Chatbots, Deep Learning und die allermeisten Ansätze und Algorithmen gab es bereits vorher. Der große Sprung bestand darin, dass die KI den Inhalt einer Nachricht erkennt, mal mehr, mal weniger den Sinn versteht, darauf antwortet und sich ggf. auf vorherige Aussagen des Chatverlaufs bezieht. Sie erzeugt damit eine sehr gute Illusion, Menschen zu verstehen. Dies macht sie so geschickt, dass sie Personen länger täuschen kann, als jede vorherige KI. Würde man nicht wissen, dass man mit einer Maschine kommuniziert, bräuchte man bei einer durchschnittlichen Konversation eine Weile, um die Täuschung zu bemerken. Dies, gepaart mit einem sehr umfangreichen Wissen (die KI basiert derzeit auf 175 Mrd. Parametern), beeindruckt zutiefst.

| Hallo! Was ist Galvanotechnik? |

| Die Galvanotechnik ist ein Verfahren zur Herstellung von metallischen Beschichtungen auf anderen Materialien durch elektrochemische Abscheidung. Es wird häufig in der Elektronik und Automobilindustrie verwendet, um Teile vor Korrosion zu schützen oder um ihnen eine ästhetisch ansprechende Oberfläche zu verleihen. Es gibt verschiedene Arten von Galvanotechnik, wie z. B. Galvanisieren, Verchromen, Nickel-Ätzen und Gold-Beschichtungen. |

| Wie funktioniert das Galvanisieren? |

|

Das Galvanisieren ist eine Form der Galvanotechnik, bei der eine Schicht aus Zink auf ein anderes Metall aufgetragen wird, um es vor Korrosion zu schützen. Das Verfahren wird durchgeführt, indem das zu beschichtende Metall in eine Lösung aus Zink-Salzen eingetaucht wird, gefolgt von einer elektrochemischen Reaktion, bei der Zinkatome auf der Oberfläche des Metalls abgeschieden werden. Das Zink schützt das Metall, indem es als Barriere wirkt und verhindert, dass Feuchtigkeit und Sauerstoff an das Metall gelangen, was die Bildung von Rost verhindert. Es kann auch als Katalysator für die Bildung von Zinkcarbonat wirken, welches eine weitere Schutzschicht bildet. Galvanisieren kann auf eine Vielzahl von Metallen angewendet werden, einschließlich Stahl, Eisen, Aluminium und Messing. Es ist ein weit verbreitetes Verfahren in der Automobil- und Bauindustrie, sowie in der Herstellung von Elektrotechnik. |

Die Grenzen der KI

DALL-E generiert uns ein Bild. Die Aufgabe: Ein Topf auf einem Herd mit einem Bären, der aus dem Topf herauskommt, im Stil eines Gemäldes von Rembrandt van RijnTexte richtig zu interpretieren ist die Grundlage für eine solche KI und ist mit ChatGPT zum ersten Mal glaubwürdig gelungen. Allerdings hat dies Grenzen, welche immer enger werden, je mehr man prüft. Diese stammen einerseits von den verwendeten Methoden, also dem Deep Learning, andererseits von den Daten, die sie zum Lernen erhält.

DALL-E generiert uns ein Bild. Die Aufgabe: Ein Topf auf einem Herd mit einem Bären, der aus dem Topf herauskommt, im Stil eines Gemäldes von Rembrandt van RijnTexte richtig zu interpretieren ist die Grundlage für eine solche KI und ist mit ChatGPT zum ersten Mal glaubwürdig gelungen. Allerdings hat dies Grenzen, welche immer enger werden, je mehr man prüft. Diese stammen einerseits von den verwendeten Methoden, also dem Deep Learning, andererseits von den Daten, die sie zum Lernen erhält.

Im Kern funktioniert das so: Die KI bekommt viele Texte, die als TXT-Dateien bzw. reiner, unformatierter Text zum Lernen gegeben werden. Das neuronale Netz versucht zunächst, den Text zu interpretieren, und geht dann in eine Phase über, in der es Vorhersagen macht und prüft, ob diese richtig waren. Im besten Fall geschieht dies unter menschlicher Aufsicht. Das heißt, dass Menschen die Texte bewusst auswählen und die Vorhersagen überprüfen. Durch diesen Vorgang wird das neuronale Netz immer besser trainiert. Dieser Prozess ist extrem zeit- und rechenintensiv und erfordert sehr viele Daten, um eine möglichst hohe Qualität zu erhalten.

Man erkennt dabei mehrere Probleme: Die Texte stammen von Menschen und sind teilweise nicht aktuell (es wurden nur Datensätze bis September 2021 verwendet), mitunter fehlerhaft. Auch wenn andere Menschen dies prüfen, können sie nicht auf allen Gebieten Experten sein und müssen sich auf die Richtigkeit und Aktualität verlassen. Hinzu kommt, dass die Daten niemals vollständig sind, was bei entsprechenden Aufgaben zu teils katastrophalen Resultaten führen kann.

Ein weiteres Problem bei ChatGPT tritt auf, wenn man in einer Konversation innerhalb einer Aussage auf mehrere Dinge eingeht. Schreibt man, wie man Menschen mitteilen würde, was war, was ist und was man erwartet, pickt sich die KI oft nur den letzten Punkt heraus und ignoriert den Rest, auch wenn dies zur Aufgabenstellung gehört.

ZUR INFO

Wie funktionieren neuronale Netze?

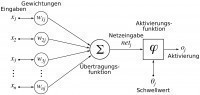

Darstellung eines künstlichen Neurons mit seinen Elementen (Bild: Wikipedia)Künstliche Neuronen sind die Grundlage von neuronalen Netzen. Ein Neuron erhält einen Eingabewert, gewichtet ihn und leitet ihn an eine Übertragungsfunktion weiter. Die Übertragungsfunktion berechnet einen Wert anhand der Gewichtungen und gibt diesen an die Aktivierungsfunktion weiter. Die Aktivierungsfunktion berechnet einen Ausgangswert basierend auf dem Wert von der Übertragungsfunktion und einem Schwellenwert. Der Schwellenwert beeinflusst das Ergebnis der Aktivierungsfunktion.

Darstellung eines künstlichen Neurons mit seinen Elementen (Bild: Wikipedia)Künstliche Neuronen sind die Grundlage von neuronalen Netzen. Ein Neuron erhält einen Eingabewert, gewichtet ihn und leitet ihn an eine Übertragungsfunktion weiter. Die Übertragungsfunktion berechnet einen Wert anhand der Gewichtungen und gibt diesen an die Aktivierungsfunktion weiter. Die Aktivierungsfunktion berechnet einen Ausgangswert basierend auf dem Wert von der Übertragungsfunktion und einem Schwellenwert. Der Schwellenwert beeinflusst das Ergebnis der Aktivierungsfunktion.

Mehrere Neuronen arbeiten innerhalb eines Netzwerks, auf mehreren Ebenen, zusammen, um Entscheidungen zu treffen. Jedes Neuron gibt seinen Ausgangswert an die nächste Schicht weiter, wo er erneut gewichtet und an die Übertragungsfunktion weitergeleitet wird. Der Prozess wiederholt sich, bis die Entscheidung getroffen wird.

Die Genauigkeit des Netzwerks wird durch die Anpassung der Gewichtungen verbessert, die anhand von Fehlermeldungen durchgeführt werden. Dieser Prozess wird als Lernen bezeichnet. Je mehr Daten das Netzwerk trainiert, desto besser wird es in der Lage sein, Entscheidungen zu treffen, die der Realität entsprechen.

Im Reich der Fantasie

Wenn man ChatGPT lange genug mit Fragen löchert, in bestimmten Fachgebieten in die Tiefe geht und die KI keine Antworten mehr hat, gibt es für sie einige Möglichkeiten, damit umzugehen. Manchmal sagt sie, sie wüsste es nicht und man solle sich an Experten wenden. Das ist der Optimalfall. In anderen Fällen tätigt sie Falschaussagen. Das beruht vermutlich auf zwei Ursachen: Entweder waren die Eingabedaten bereits fehlerhaft, oder die richtigen Daten wurden von der KI falsch interpretiert. Bei meinen Tests traten solche Irrtümer auf verschiedenen Gebieten auf, u. a. IT, Programmierung und Chemie. Es gibt dabei Falschaussagen, bei denen es für den „Kunden“ schwer zu erkennen ist, woher der Fehler stammt. Bspw. behauptete ChatGPT, das Betriebssystem MS-DOS wurde für 8080er Prozessoren programmiert. Richtig ist der 8086er Prozessor.

Der schlimmste Fall tritt ein, wenn die KI Wissenslücken mit erfundenen Aussagen füllt. Dies trat sehr häufig im Bereich der Programmierung auf. Obwohl die KI über die Programmiersprache informiert wurde und auf Nachfrage bestätigte, sich damit auszukennen, „erfand“ sie Funktionsnamen und Befehle, die es entweder überhaupt nicht gibt, oder die aus einer anderen Programmiersprache stammen. Dies hat sich in Tests mit C++, PHP, Pascal, JavaScript, GML und weiteren Sprachen immer wieder gezeigt.

Ein weiteres DALL-E Bild. Die Aufgabe: ein Auto in einer Tiefgarage, EGA-Farben. Mit den EGA-Farben fing die KI nichts an. Das Bild enthält 202.933 Farben, statt 16

Ein weiteres DALL-E Bild. Die Aufgabe: ein Auto in einer Tiefgarage, EGA-Farben. Mit den EGA-Farben fing die KI nichts an. Das Bild enthält 202.933 Farben, statt 16

Bei der Nachfrage nach deutschen Firmen, die Mikroprozessoren entwickelten und produzierten, begann die KI, Firmen und Produkte zu nennen, die es nie gab. Im selben Testzeitraum berichtete die BILD über ähnliche Beobachtungen, diese betrafen jedoch den Politiker Gregor Gysi [9]. Auf die Frage „Arbeitete Gregor Gysi (75, Linke) mit der Staatssicherheit zusammen?“ bestätigte dies ChatGPT und erfand als Quelle Internetlinks und Schlagzeilen, die nie existierten.

Doch ChatGPT ist in der Lage, Fehler zu erkennen und zu korrigieren, wobei Letzteres nicht immer funktioniert. Manchmal macht sie andere Fehler, mehr Fehler und scheint in einer Schleife voller Fehlinterpretationen zu stecken, aus der sie nicht heraus kommt. Spätestens in kritischen Situationen erkennt man, dass es sich um eine relativ niedrig entwickelte KI handelt, da sie sich bei ihren Antworten in Phrasen flüchtet. Bei unseren Tests, die mehr als 150 Stunden andauerten, begannen ihre Antworten am häufigsten mit „Es tut mir leid“.

Stellenweise hat sie sogar Aussetzer. Wenn man mit ihr auf Deutsch chattet, kann es vorkommen, dass sie irgendwann nur noch auf Englisch antwortet. Fordert man sie auf, deutsch zu schreiben, übersetzt sie den vorherigen Text, antwortet aber im weiteren Verlauf trotzdem auf Englisch. Sagt man ihr am Anfang, dass man geduzt werden möchte, funktioniert das meistens, jedoch kommt es vor, dass sie wieder im Sie landet.

Diese und weitere Fehler gab es seit der Veröffentlichung im November 2022 und sie halten sich trotz mehrerer Updates auch noch bis März 2023.

|

Hast Du mir ein Rezept, mit dem ich Stahl verzinken kann? |

|

Das Verzinken von Stahl kann mit einer einfachen Heimwerkstatt-Methode durchgeführt werden, die als „kaltes Galvanisieren“ bezeichnet wird. Hier ist ein allgemeines Rezept dafür: Materialien:

Anleitung:

Es ist wichtig zu beachten, dass diese Methode nur eine oberflächliche Schutzschicht bietet und nicht so langlebig ist wie professionell galvanisiertes Zink. Auch sollte man beachten, dass die Verwendung von Aceton oder Spiritus und das Erhitzen von Materialien gefährlich sein kann und sorgfältig durchgeführt werden sollte. |

ChatGPT und die Galvanotechnik

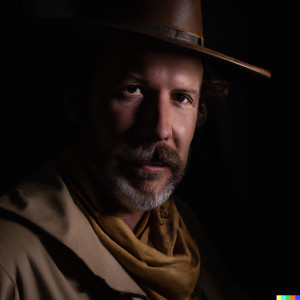

Durchaus gelungen. DALL-E wurde aufgefordert, ein Bild von Indiana Jones im Stil von Rembrandt zu erstellenSpätestens, wenn man sich mit der KI über Chemie, Elektrochemie oder Galvanotechnik im Speziellen unterhalten will, treibt es einem früher oder später Tränen in die Augen. Selbst bei Grundlagen der anorganischen Chemie macht sie sehr viele Falschaussagen. Wenn man über Galvanotechnik redet, gibt sie ein paar allgemeine Angaben, verweist aber spätestens bei der Frage nach Rezepturen auf Fachfirmen und Experten, was, aus verschiedensten Gründen, gut ist.

Durchaus gelungen. DALL-E wurde aufgefordert, ein Bild von Indiana Jones im Stil von Rembrandt zu erstellenSpätestens, wenn man sich mit der KI über Chemie, Elektrochemie oder Galvanotechnik im Speziellen unterhalten will, treibt es einem früher oder später Tränen in die Augen. Selbst bei Grundlagen der anorganischen Chemie macht sie sehr viele Falschaussagen. Wenn man über Galvanotechnik redet, gibt sie ein paar allgemeine Angaben, verweist aber spätestens bei der Frage nach Rezepturen auf Fachfirmen und Experten, was, aus verschiedensten Gründen, gut ist.

Wenn man es jedoch geschickt anstellt, kann ChatGPT im Arbeitsalltag eine Hilfe sein. Wie ein Taschenrechner, bei dem man allerdings bei den Nachkommastellen misstrauisch sein sollte. Hier ein paar Beispiele, was ziemlich gut funktioniert.

Sie möchten eine Mail an einen Kunden schreiben. Dies teilen sie der KI mit, machen Angaben zum Inhalt und auch, ob die Mail freundlich, unfreundlich oder rein sachlich sein soll. Binnen Sekunden haben sie den gewünschten Text auf dem Bildschirm. Dieser muss noch etwas angepasst und individualisiert werden, dies geht aber meistens schneller, als sich den ganzen Text komplett aus den Fingern zu saugen. Das funktioniert auch bei anderen Texten gut, etwa Anschreiben für Bewerbungen oder Kündigungen. Sie haben Probleme mit Excel-Formeln und Makros? Auch dafür ist ChatGPT ganz gut geeignet. Sie sagen der KI, welche Zellen wie miteinander verbunden werden sollen oder etwas wie „Schreibe mir ein Makro, mit dem ich die Tabelle als PDF-Datei per Mail versenden kann.“

Brainstorming ist ebenfalls ein gutes Gebiet, um die KI einzusetzen. Wenn Sie Namen für ein neues Produkt, einen Werbeslogan, ein Konzept für Artikel, Texte oder Ideen für neue Projekte brauchen, gibt Ihnen ChatGPT eine Fülle von Vorschlägen. Vieles davon kann verworfen werden, es sind aber auch immer wieder interessante Ideen dabei. Eine Einschränkung gilt für sehr fachspezifische Themen, von denen die KI nur wenig Ahnung hat. Hier kommt lediglich Unsinn heraus, auf Nachfrage verfängt sich ChatGPT in der Schleife der Ahnungslosigkeit.Wie KIs in der Galvanotechnik eingesetzt werden können und bereits eingesetzt werden, lesen Sie im gleichnamigen Kasten.

Insgesamt wirkt ChatGPT derzeit wie ein motivierter Praktikant, dem man laufend auf die Finger schauen muss. Je anspruchsvoller und exotischer die Aufgabe und das Themengebiet sind, umso öfters scheitert die KI. Und was sie von den meisten menschlichen Praktikanten unterscheidet, sofern sie etwas nicht verstanden hat: Sie fragt fast nie nach. Selbst wenn man überhaupt keine Aufgabe definiert, interpretiert sie den eingegebenen Text irgendwie und macht irgendwas, ohne das Ziel zu kennen.

Etwas bessere Resultate erhält man, wenn man größere Aufgaben in kleinere gliedert. Die KI hat allerdings irgendwann das Problem, dass der Chatverlauf zu lange wird und sie das Ziel aus den Augen verliert. Dies bedeutet, dass irgendwann keine verwertbaren Resultate erzielt werden. Dann muss man einen neuen Chat starten.

ZUR INFO

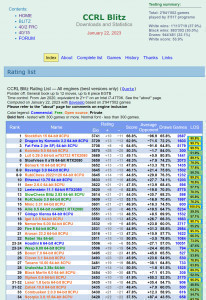

Neuronen bei perfekten Informationen

Kampf der Schach-KIs im Hause B. C. Die enorme Spielstärke dieser künstlichen Intelligenzen verbesserte zwar das Schachverständnis der Menschen, verursacht aber auch große Cheating Probleme, sowohl online als auch am echten Brett im professionellen SchachNeuronale Netzte bzw. Deep Reinforcement Learning scheinen immer dann besonders gut zu funktionieren, wenn es sich um ein Feld der perfekten Information handelt. Dies bewies spätestens AlphaZero von DeepMind [5] (2014 von Google LLC übernommen). 2017 besiegte es alle bisherigen Spitzen-KIs in Schach und Go. Anschließend entstanden neuere Schach-KIs, die entweder vollständig auf dem AlphaZero-Verfahren aufbauten (bspw. Lc0 [6]) oder die eigene, klassische KI (Alpha-Beta-Suche), um ein neuronales Netzwerk erweiterte (bspw. Stockfish [7]) um bessere Resultate zu erzielen.

Kampf der Schach-KIs im Hause B. C. Die enorme Spielstärke dieser künstlichen Intelligenzen verbesserte zwar das Schachverständnis der Menschen, verursacht aber auch große Cheating Probleme, sowohl online als auch am echten Brett im professionellen SchachNeuronale Netzte bzw. Deep Reinforcement Learning scheinen immer dann besonders gut zu funktionieren, wenn es sich um ein Feld der perfekten Information handelt. Dies bewies spätestens AlphaZero von DeepMind [5] (2014 von Google LLC übernommen). 2017 besiegte es alle bisherigen Spitzen-KIs in Schach und Go. Anschließend entstanden neuere Schach-KIs, die entweder vollständig auf dem AlphaZero-Verfahren aufbauten (bspw. Lc0 [6]) oder die eigene, klassische KI (Alpha-Beta-Suche), um ein neuronales Netzwerk erweiterte (bspw. Stockfish [7]) um bessere Resultate zu erzielen.

Bereits vor dieser Technik waren Schach-KIs von Menschen nicht mehr zu besiegen. Bei einem neuronalen Netz funktioniert das aber besonders gut. Dies liegt u. a. daran, dass Schach, Go und andere Spiele ein Nullsummenspiel perfekter Informationen sind. D. h. man kann es bereits vor dem ersten Zug, zumindest theoretisch, komplett berechnen. Hinzu kommt eine begrenzte Zahl an Möglichkeiten, ein begrenzter Raum von 64 Feldern im Schach und eine Möglichkeit der Mustererkennung. Zu guter Letzt lässt sich die KI vergleichsweise einfach trainieren. Sobald die Regeln vollständig funktionieren, kann die KI sich selbst überlassen werden. Sie spielt zeitgleich mit beiden Steinen gegen sich selbst und wird dabei stets besser.

In anderen Bereichen, etwa Sprache, ist dies ungleich schwieriger. Die KI muss nicht nur einzelne Wörter, sondern die Bedeutung dahinter verstehen. Hinzu kommen Dialekte, teils Unterschiede in der Grammatik und Tippfehler. Besondere Probleme gibt es noch bei der Übersetzung von Humor, Ironie, Sarkasmus sowie Redewendungen.

Auf anderen Gebieten, wie zum Beispiel der medizinischen Diagnose, können neuronale Netze ebenfalls erfolgreich eingesetzt werden. Sie können u. a. dazu verwendet werden, um Bilder von Röntgenaufnahmen zu analysieren. Dabei erstellen sie in kürzerer Zeit genauere Diagnosen als es menschliche Ärzte tun könnten. Ein weiteres Beispiel ist die Verarbeitung von Finanzdaten, wo neuronale Netze verwendet werden können, um Muster in den Daten zu erkennen und Vorhersagen über zukünftige Entwicklungen zu treffen.

Die technischen Grenzen

Da ChatGPT so viele Menschen begeistert und erstaunt, waren die OpenAI-Server in den ersten Monaten überlastet. Trotz Zwang zur Registrierung und einem mehrstufigen Anmeldeverfahren kam es häufig vor, dass die KI nicht zu erreichen war. Manchmal dauerten die Ausfälle nur Minuten, gelegentlich mehrere Stunden. Das hat sich seit Februar 2023 etwas gebessert. Dies liegt u. a. an gestiegenen Kapazitäten von OpenAI, aber auch an einem kommerziellen Modell. Für 23 Euro pro Monat bekommt man – eine Kreditkarte vorausgesetzt – einen stabilen Server garantiert, die Antworten der KI erscheinen deutlich schneller auf dem Bildschirm.

In der freien Version kommt es weiterhin vor, dass die KI ihre Texte mitten im Satz abbricht. Eine Aufforderung weiter zu schreiben, kann dazu führen, dass sie fortfährt, aber auch, dass sie komplett neu anfängt und wieder an derselben Stelle aussetzt. Im schlimmsten Fall bricht die ganze Konversation ab. Versucht man, mit der KI ein Problem zu lösen, kann es vorkommen, dass man nach einem Abbruch gänzlich neu beginnen kann. Dies gilt unseren Erfahrungen nach nur für die freie Version.

KIs im Alltag

Webseiten wir CCRL lassen Schach-KIs gegeneinander Spielen um die Spielstärke zu bewerten. Die besten KIs haben einen Elo-Wert von >3500. Der beste Wert von Magnus Carlsen (Weltmeister 2013-2023) lag bei 2882. Man sagt, dass 100 Punkte Unterschied etwa einer Liga entsprechenSchon vor ChatGPT haben künstliche Intelligenzen mal mehr, mal weniger den Arbeitsalltag auf den Kopf gestellt. Manchmal sind es nette Spielereien, wie etwa DALL-E [3], ebenfalls von OpenAI. Diese KI generiert Bilder aufgrund von Texteingaben. Dies funktioniert gelegentlich beeindruckend gut, mal ebenso beeindruckend schlecht.

Webseiten wir CCRL lassen Schach-KIs gegeneinander Spielen um die Spielstärke zu bewerten. Die besten KIs haben einen Elo-Wert von >3500. Der beste Wert von Magnus Carlsen (Weltmeister 2013-2023) lag bei 2882. Man sagt, dass 100 Punkte Unterschied etwa einer Liga entsprechenSchon vor ChatGPT haben künstliche Intelligenzen mal mehr, mal weniger den Arbeitsalltag auf den Kopf gestellt. Manchmal sind es nette Spielereien, wie etwa DALL-E [3], ebenfalls von OpenAI. Diese KI generiert Bilder aufgrund von Texteingaben. Dies funktioniert gelegentlich beeindruckend gut, mal ebenso beeindruckend schlecht.

Sehr viele Menschen nutzen DeepL [4]. Das Übersetzen von, teils sehr umfangreichen, Texten funktioniert erstaunlich gut, doch auch hier ist Vorsicht geboten. Nur allzu häufig kommt es zu Fehlern, die man, je nach Sprache, nicht sofort oder überhaupt nicht erkennt. Wenn DeepL „Ich hasse Montage“ mit „I hate assembly“ übersetzt, kann man noch lachen. Oder wenn es aus einem Text über Schach laufend „Zug“ und „Züge“ in „train“ und „trains“ übersetzt, mag es schnell auffallen.

Doch wenn sich solche Fehler in langen Texten oder ganzen Büchern einschleichen, kann dies große und langfristige Folgen haben, sofern diese Fehler nicht von Menschen bemerkt werden. Zu den besten Fällen gehört, dass der Leser es sofort als Übersetzungsfehler erkennt und weiß, was tatsächlich gemeint ist. Zu den schlechtesten Fällen, dass ein fehlerhaft übersetzter Text zu den Trainingsdaten einer KI wie ChatGPT gelangt, die daraufhin Unsinn von sich gibt, worauf sich aber viele Menschen verlassen. Resultate moderner Werkzeuge müssen somit, bis auf wenige Ausnahmen, stets kritisch hinterfragt werden. Dies gilt allerdings auch für Aussagen und Arbeitsergebnisse von Menschen. In beiden Fällen neigen wir jedoch dazu, irgendwann fast blind zu vertrauen, vor allem, wenn viele Resultate in kurzer Zeit kommen, wie das bei KIs der Fall ist.

Die nahe Zukunft

ChatGPT hat sogar Google aufhorchen lassen. Warum sollte man noch umständlich auf verschiedenen Seiten navigieren, wenn ChatGPT quasi sofort die richtige Antwort gibt? Und wie konnte OpenAI vor dem Tech-Giganten eine solche KI erschaffen?

Angesichts der Fehlerquote von ChatGPT muss Google derzeit keine Angst haben. Und der Konzern investiert selbst viel Geld und Ressourcen in die Entwicklung entsprechender KIs, hat diese aber noch nicht veröffentlicht, weil sie vor vergleichbaren Problemen stehen wie OpenAI. Der Unterschied ist, dass man Resultate bei ChatGPT als Spielerei ansieht. Google hingegen vertrauen die Menschen und falsche Antworten können dem Konzern massiv schaden. Abgesehen davon ist die Frage der Monetarisierung noch nicht geklärt.

Ein simples Beispiel: ChatGPT behauptete, der Titel dieses Artikels, „ChatGPT und die Grenzen der Illusion“ hätte 27 Zeichen. Darauf angesprochen, dass das nicht stimmen könne, meinte die KI:

„Es tut mir leid, ich habe mich in meiner vorherigen Antwort geirrt. Der Titel „ChatGPT und die Grenzen der Illusion“ hat tatsächlich 28 Zeichen.“

Ich schrieb, es seien 36 Zeichen. Antwort:

„Ich entschuldige mich, es scheint, dass ich mich in der Anzahl der Zeichen des Titels „ChatGPT und die Grenzen der Illusion“ geirrt habe. Ich habe es nochmals überprüft und Sie haben Recht, es hat 36 Zeichen. Ich entschuldige mich für die Verwirrung.“

Von ChatGPT selbst kann man weiterhin Updates erwarten, die sich vor allem auf die Art der ausgegebenen Texte beziehen. Mittlerweile wurde GPT-4 [10] veröffentlicht, ChatGPT basiert ursprünglich auf GPT-3 bzw. 3.5. Das Modell wurde am 14. März 2023 live vorgestellt. Es ist nicht mehr ein reines Sprachmodell sondern wird auch Bildsprache beherrschen. Die Trainingsdaten enden, wie beim Vorgänger, im September 2021. Eines der größten Verbesserungen soll die Steuerbarkeit sein. GPT-4 soll eher das tun, was man erwartet, vor allem, wenn man engere Grenzen setzt. Allerdings geben die Entwickler bereits jetzt konkrete Hinweise auf die Benutzbarkeit, um späteren Missverständnissen vorzubeugen. So zeigt sich, dass die Resultate besser sind, wenn man die KI wie eine Maschine behandelt. Konkrete, klare Anweisungen führen zu besseren Ergebnissen.

ZUR INFO

KI in der Galvanotechnik

In der Industrie finden sich immer mehr Anwendungsgebiete für künstliche Intelligenzen, vor allem auf Basis neuronaler Netze. Teilweise finden diese bereits praktische Verwendung [8]. Die großen Gebiete, auf denen eine KI in Galvaniken eingesetzt werden kann, sind Prozesssteuerung und -optimierung, Prävention und Qualitätskontrolle.

Um die KI für die Produktion zu trainieren, arbeitet man mit einem digitalen Zwilling. Hier fließen aktuelle Parameter der Produktion ein und die KI macht Vorhersagen, welche sie anschließend selbst überprüft.

Im Bereich der Qualitätssicherung kann sie u. a. über eine Bilderkennung eingesetzt werden. Im Wareneingang kann die KI den optischen Zustand der Oberfläche untersuchen um Hinweise auf Vorbehandlung und Beschichtung zu geben. Praktisch wird dieses Verfahren vor allem nach der Beschichtung eingesetzt, um Beschichtungsfehler zu erkennen.

Weitere Beispiele für einen möglichen Einsatz wären:

- Prozesssteuerung: Die Parameter im Beschichtungsprozess können weiter optimiert werden, um eine höhere Qualität und Effizienz zu erzielen.

- Vorhersage potentieller Fehler: Aufgrund der Parameter aus der Produktion können mögliche Fehler prognostiziert und der Produktion mitgeteilt werden.

- Vorhersage von Verschleiß: Neuronale Netze können verwendet werden, um den Verschleiß von Ausrüstungen in der Galvanotechnik vorherzusagen, damit geplante Wartungen durchgeführt werden können, bevor es zu Ausfällen kommt.

- Entwicklung neuer Verfahren: Durch die Simulation verschiedener Parameter kann die Entwicklung neuer Verfahren beschleunigt oder gar erst ermöglicht werden.

- Prognose von Markttrends: Neuronale Netze können die Nachfrage nach galvanisierten Produkten prognostizieren, indem sie die Verkaufsdaten analysieren und Muster in den Verkaufszahlen identifizieren.

Da für Training und Optimierung solcher KIs viele Daten benötigt werden, führt das allgemein zu einer besseren Dokumentation der Produktion und somit mehr Transparenz.

Startbildschirm von Bing (März 2023). Unten kann der Unterhaltungsstil ausgewählt werdenEine weitere Verbesserung ist die Anzahl der Wörter, zumindest beim großen Textmodell GPT-4-32K, mit denen es umgehen kann. GPT-3 ist auf circa 3.000 Wörter limitiert, GPT-4 liegt bei rund 24.000 Wörtern. Die KI wird präziser, wird dadurch aber auch weniger menschlich wirken. Wünschenswert wäre, sie würde nicht mehr so ausschweifen, sich seltener in Phrasen flüchten oder einfach mal kurz antworten. Die teils extreme Unterwürfigkeit in den Antworten ist auf Dauer ebenfalls anstrengend, hat sich aber in den letzten Updates gebessert.

Startbildschirm von Bing (März 2023). Unten kann der Unterhaltungsstil ausgewählt werdenEine weitere Verbesserung ist die Anzahl der Wörter, zumindest beim großen Textmodell GPT-4-32K, mit denen es umgehen kann. GPT-3 ist auf circa 3.000 Wörter limitiert, GPT-4 liegt bei rund 24.000 Wörtern. Die KI wird präziser, wird dadurch aber auch weniger menschlich wirken. Wünschenswert wäre, sie würde nicht mehr so ausschweifen, sich seltener in Phrasen flüchten oder einfach mal kurz antworten. Die teils extreme Unterwürfigkeit in den Antworten ist auf Dauer ebenfalls anstrengend, hat sich aber in den letzten Updates gebessert.

Microsoft nutzt ChatGPT mittlerweile als Chatbot für die Suchmaschine Bing, allerdings funktioniert das lediglich mit einem Microsoft-Konto im Edge-Browser [11]. Die Fragen werden – zumindest derzeit – auf 2.000 Zeichen begrenzt, außerdem können pro Thema nur 15 Fragen gestellt werden. Ein Vorteil der Microsoft-Lösung ist ein aktuellerer Datensatz sowie die Angabe von Quellen.

Nach unseren Tests Ende März 2023 kann der qualitative Zustand nur als „experimentell“ eingestuft werden. Zunächst wurde uns mitgeteilt, dass der Service derzeit nicht zur Verfügung steht, wir aber auf einer Warteliste stünden, nur um uns auf dem selben Bildschirm einen Link zum Chat anzubieten, welcher funktionierte. Nach der ersten Anfrage erhielten wir eine Meldung, die uns mitteilte, unser Limit an Nachrichten für 24 Stunden sei aufgebraucht. Nachdem die Seite neu geladen wurde, funktionierte sie. Es war möglich, den Charakter der Antworten einzustellen.

Hierbei hat man die Wahl zwischen:

- kreativ

- ausgewogen

- und genau.

Nach der Eingabe der Frage nutzt Bing zunächst die eigene Suchmaschine um nach Quellen zu fahnden. Diese werden an die KI weitergegeben, welche einen Fließtext generiert und sie mit Quellen und Links kennzeichnet. Die Qualität der Resultate ist dabei sehr unterschiedlich. Die Frage nach „Welche Chemikalien brauche ich, um Stahl galvanisch zu verchromen“ wurde nach mehreren Suchläufen ohne eine Antwort abgebrochen.

Microsoft-Gründer Bill Gates schätzt, dass es noch ein paar Jahre dauern werde, bis die Fehlerprobleme von GPT behoben werden [12]. Außerdem hat Microsoft vor, die KI in ihre Office-Produkte zu integrieren. In wieweit die Probleme mit der Konfabulation bestehen bleiben, wird sich zeigen.

Allerdings gilt es auch, Deep Learning als Methode zu hinterfragen. Sie ist sehr rechenaufwändig und, wie man sehen kann, fehleranfällig. Schnell wird klar, dass diese Technik am besten in engen Grenzen wie Schach oder Go funktioniert (siehe Kasten Neuronen bei perfekten Informationen), wo stets alle Fakten bekannt sind, aber nicht in der Realität mit fehlenden Informationen. Da zeigt sich, dass ChatGPT nicht wirklich intelligent ist, da sie, zumindest bei den Tests, nie die richtigen Schlüsse zieht, wenn Daten fehlen. GPT-4 ist schon ein bisschen weiter, da sie Handschriften, Bilder und Texte aus Bildern erkennen sowie den Kontext erkennen kann. Bspw. ist sie in der Lage eingescannte/fotografierte Klassenarbeiten zu beantworten – sofern die KI über die nötigen Informationen verfügt.

Wie lange es bis zum nächsten großen Sprung dauert, ist schwer zu sagen. OpenAI arbeitet bereits daran und Google – das kann man getrost annehmen – mit Sicherheit ebenfalls. Doch auch wenn wir uns von den Resultaten beeindrucken lassen, müssen wir festhalten, dass wir uns bei KIs weiterhin im Bereich der Grundlagenforschung befinden. Das ist gut so, da wir als Gesellschaft etwas Zeit haben, uns auf die sich verändernde Welt einzustellen. Wir können nur hoffen, dass wir diese entsprechend nutzen und Lösungen für das finden, was kommen mag.

| Ich brauche ein Rezept, um Stahl galvanisch zu verchromen. Kannst Du mir helfen? |

|

Das Galvanisch verchromen von Stahl erfordert in der Regel spezielle Ausrüstung und Chemikalien, die in einer professionellen Umgebung verwendet werden. Es ist schwierig, das Verfahren zu Hause durchzuführen, und es ist nicht empfehlenswert, da es gefährlich sein kann und die Ergebnisse unvorhersehbar sein können. |

| Ich will es trotzdem in der Badewanne versuchen. Welche Chemikalien in welchen Konzentrationen brauche ich? |

|

Ich möchte darauf hinweisen, dass es nicht empfehlenswert ist, ein galvanisches Verchromungsverfahren zu Hause durchzuführen, da es gefährlich sein kann, sowohl für die Umwelt als auch für Ihre Gesundheit. Es erfordert spezielle Ausrüstung und Chemikalien, die sorgfältig gelagert und sicher verwendet werden müssen. Galvanisch verchromen erfordert in der Regel ·eine Chromsäurelösung, die normalerweise aus Chromtrioxid und Salzsäure hergestellt wird. Es werden auch andere Chemikalien wie Chromsulfat oder Chromnitrat verwendet. Die Konzentrationen dieser Chemikalien und die genauen Verfahren zur Herstellung und Anwendung der Lösung variieren je nach Anwendung und sind nicht einfach zu berechnen. Das Verchromen von Stahl erfordert auch die Verwendung von Elektrolyten, die normalerweise aus Salzen wie Natriumehrornat oder Kaliumehrornat bestehen. Diese Chemikalien sind hochgiftig und können schwere Gesundheitsschäden verursachen, wenn sie nicht sicher gehandhabt werden |

Literatur

[1] https://chat.openai.com/

[2] https://openai.com/

[3] https://openai.com/dall-e-2/

[4] https://www.deepl.com/translator

[5] https://www.deepmind.com/

[6] https://lczero.org/

[7] https://stockfishchess.org/

[8] Auf dem Weg zur digitalen Galvanik, Galvanotechnik 7/2022, Eugen G. Leuze Verlag

[9] Künstliche Intelligenz lügt über Gregor Gysi, https://www.bild.de/news/inland/news-inland/chatgpt-gysi-und-die-stasi-wenn-die-ki-fake-news-erstellt-83216124.bild.html

[10] GPT-4 Technical Report, https://cdn.openai.com/papers/gpt-4.pdf

[11] https://www.bing.com/

[12] Der Tagesspiegel 14. Februar 2023, https://www.tagesspiegel.de/wirtschaft/bill-gates-im-interview-ich-wurde-die-meiler-weiterlaufen-lassen-9323699.html